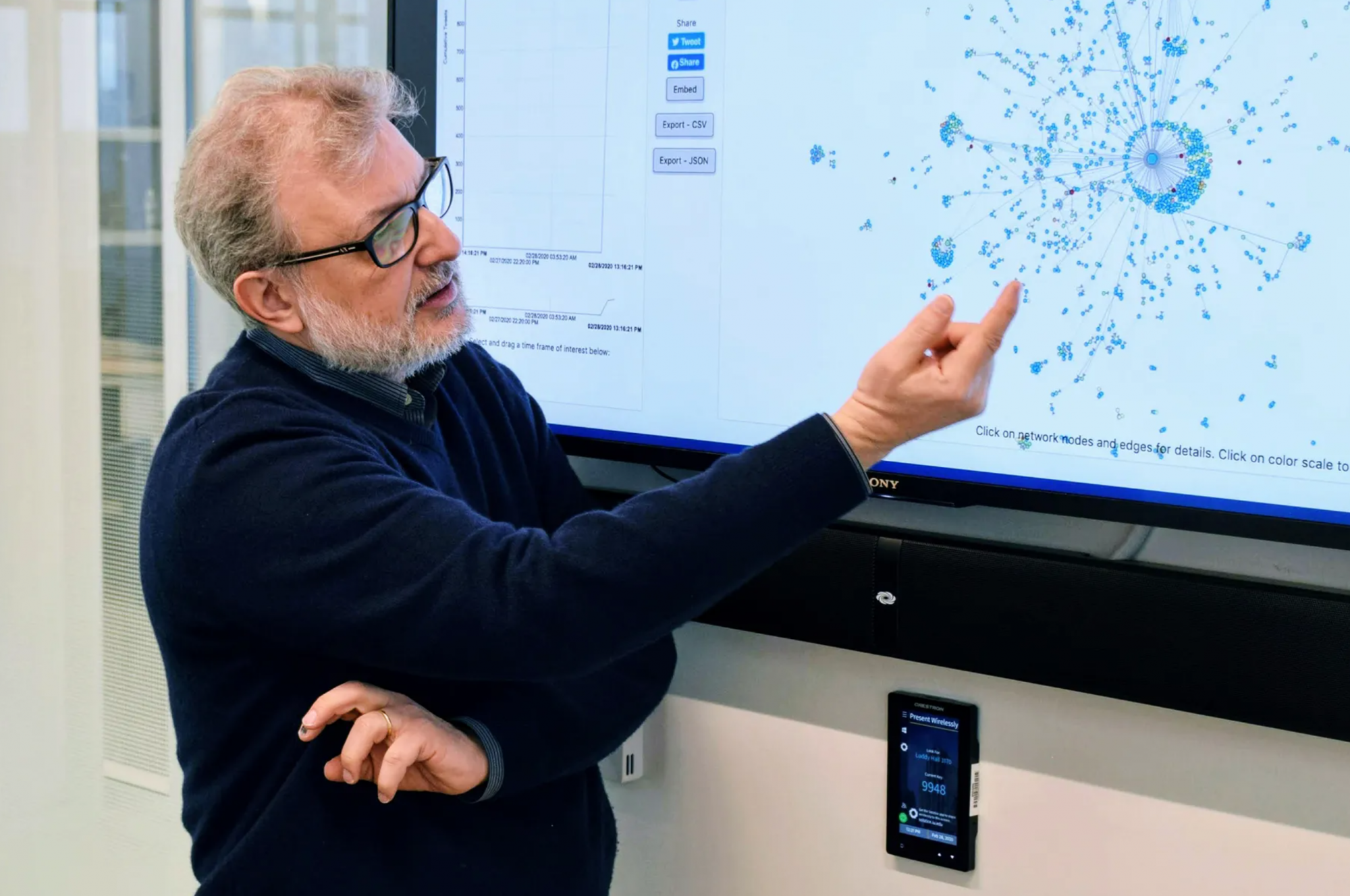

Fil Menczer prvi je put primijetio, kako ih on opisuje, "društvene botove" početkom 2010-ih. Proučavao je način na koji informacije putuju Twitterom kada je naletio na nekoliko skupova računa koji su djelovali malo sumnjivo. Neki od tih računa iste su objave podijelili tisućama puta, a drugi su ih ponovno masovno dijelili sa svakog od računa. Menczer se prisjeća kako mu je kroz glavu prošlo: "Iza ovog ne stoje ljudi."

I tako je započela njegova duga karijera u promatranju botova. Kao ugledni profesor informatike na Sveučilištu Indiana u Bloomingtonu, Menczer je proučavao način na koji se botovi razmnožavaju, manipuliraju ljudima i izazivaju sukobe. Godine 2014. bio je dio tima koji je razvio alat BotOrNot, koji pomaže ljudima uočiti lažne račune. Sada ga se smatra jednim od najboljih lovaca na internetske botove.

Ako itko može zamijetiti robote među nama, onda je to Menczer. Prije nekoliko godina počela se širiti hipoteza poznata kao teorija o mrtvom internetu, koja navodi kako su gotovo svi mrežni razgovori zamijenjeni bukom koju stvara umjetna inteligencija. Menczer je u početku tu teoriju otpisao kao glupost, ali sada je, zbog eksplozije generativnog AI-ja, promatra u novom svjetlu. Još je uvijek ne shvaća doslovno, ali je počinje shvaćati ozbiljno. "Jesam li zabrinut?", pita se. "Da, jako sam zabrinut."

Teorija o mrtvom internetu postala je popularna 2021. godine, nakon što je na opskurnom forumu objavu o njoj objavio korisnik IlluminatiPirate. On je u objavi tvrdio kako je internet postao ogromna, neljudska pustopoljina, prepuna algoritmički optimiziranih objava koje kopiraju jedna drugu. IlluminatiPirate za sve je okrivio skrivenu teoriju zavjere iza koje stoji vlada, zbog čega je cijelu priču bilo lako odbaciti. Ipak, zbog dolaska alata poput ChatGPT-ja ili Midjourneya ta teorija počela je djelovati praktički proročanski. Društvene mreže djeluju čudnije. Pretrage su se pogoršale. Praktički preko noći nagomilale su se mreže vijesti koje stvara umjetna inteligencija. Meta Platforms zamišlja budućnost u kojoj je AI uključen u kreiranje značajnog udjela objava na Facebooku i Instagramu. Stranice poput Wikipedije klecaju pod teretom proždrljivih AI alata koji kopaju po stranicama i traže nove informacije za svoje modele. Sve to stvara zatvoreni krug u kojemu AI generira sadržaj koji zadovoljava potrebe sustava preporuke koje opet generira AI, a ljudi bi u cijeloj priči mogli postati tek statisti.

Prošle su godine Renee DiResta, vodeća istraživačica za dezinformacije, i Josh Goldstein, istraživač na Sveučilištu Georgetown, počeli proučavati korištenje AI sadržaja u spamu i prijevarama. Fokusirali su se na nešto više od stotinu Facebook stranica nakrcanih AI slikama. Stranice su ukupno imale milijune pratitelja. Neke su uključivale lažne fotografije minijaturnih krava koje su pratitelje preusmjeravale na lažne stranice na kojima bi oni te kravice navodno mogli kupiti. Druge su objavljivale idilične slike malih koliba i kuća u prirodi, a klik bi vas vodio na stranice prepune oglasa.

Renee DiResta | Bloomberg

Renee DiResta | Bloomberg

Sve to dio je duge tradicije kreiranja takozvanih farmi sadržaja, kojima se zarađuje od digitalnih oglasa. Uz generativnu umjetnu inteligenciju, proces punjenja tih farmi postao je mnogo efikasniji. Ne samo to, nego istraživanje oglašivačke industrije pokazuje kako generativna umjetna inteligencija botovima olakšava simulirati autentičnu korisničku aktivnost, zbog čega izgleda kao da na oglase klikaju stvarne osobe.

U svojem radu, DiResta i Goldstein identificirali su stranice na Facebooku prema kopiranim popratnim tekstovima koje su dijelile. "To je moja prva torta! Hoću čuti vaše ocjene", pisalo je u jednom od tih tekstova uz najmanje 18 različitih "fotografija" 18 različitih AI ljudi koji stoje pored 18 različitih AI torti. Stranice su privlačile ljudske pratitelje koji nisu znali o čemu se radi. Još je šokantniji primjer AI slika Isusa Krista prikazanog u formi raka koja je dobila stotine tisuća reakcija. AI umjetnost loše kvalitete na internetu se dovoljno proširila da su toj vrsti sadržaja promatrači dali i ime: talog.

Širenje dezinformacija

U nekim slučajevima, motivacija iza tog taloga nije jednostavno komercijalna. Ruska mreža za širenje dezinformacija Pravda je, na primjer, objavila milijune članaka na stotinama internetskih stranica kreiranih od početka ruske invazije na Ukrajinu, možda i u pokušaju da manipulira samim AI modelima proizvodnjom gomile propagande koje modeli mogu proždrijeti i na njima se obučavati. Nedavno je medijski regulator NewsGuard pronašao reference na te stranice u odgovorima najpopularnijih chatbotova.

Alati za generativnu umjetnu inteligenciju koji kreiraju taloge na gotovo industrijskoj razini došli su u odlično vrijeme, taman kada su društvene platforme odustale od preporučivanja objava prijatelja i obitelji i okrenule se promoviranju sadržaja korisnika koje pojedinac ne prati. To je pomoglo nasumičnim računima da počnu širiti talog dalje nego što bi to možda mogli ranije, kada su društvene mreže bile društvenije. I zaista, što je više DiResta reagirala na te stranice, to je viđala više taloga. "Sadržaj se nije samo kreirao, već se i preporučivao", objašnjava. "Strojevi pomažu tom sadržaju da brže dođe do nas."

Talog se ljudima ponekad zaista i sviđa. Može biti dovoljno bizaran da vas natjera da se zaustave na sadržaju; a ponekad nešto što nije vezano za stvarnost zaista i jest slađe ili privlačnije nego slike iz stvarnog svijeta. "Ako se ograničite samo na stvari koje su se zbilja dogodile ili šale koje je osmislila neka stvarna osoba, to je poprilično ograničen bazen sadržaja", objašnjava Jeff Allen, suosnivač i glavni istraživač u think tanku za sigurnost i povjerenje Integrity Institute. "AI povećava taj bazen."

S druge strane, sadržaj koji generira i promovira umjetna inteligencija također funkcionira kao invazivna vrsta, šireći se toliko brzo da negativno utječe na druge stanovnike interneta. "To je kao širenje algi koje može dovesti do gušenja života kakav želite imati u zdravom ekosustavu", kaže Allen.

U veljači je OpenAI izvijestio o nekim "zlonamjernim upotrebama" svojih modela. U jednom primjeru, lažna organizacija mladeži iz Gane upotrijebila je AI članke i komentare kako bi pokušala utjecati na izbore u toj državi prošle godine. U drugom su deseci računa potencijalno povezanih s kiberkriminalcima iz Sjeverne Koreje dobili stvarne poslove u kompanijama na Zapadu s pomoću životopisa i motivacijskih pisama koje je generirao AI. Upotrijebili su alate OpenAI-ja kako bi se probili kroz razgovore za poslove, a nakon što su poslove i dobili, kako bi svojim novim kolegama objasnili zašto ih nikad nema na videopozivima. Iz OpenAI-ja kažu, očekivano, kako njihova pravila strogo zabranjuju takvu prijevaru.

Botovi napadaju

Drugi problem su razmjeri češljanja interneta od AI kompanija koje te informacije koriste za treniranje svojih modela. Prema Tollbitu, kompaniji koja pomaže izdavačima dobiti naknade za te informacije koje kompanije prikupljaju, volumen se od trećeg do četvrtog tromjesečja prošle godine više nego udvostručio. Kada je preminuo bivši američki predsjednik Jimmy Carter, usluge Wikimedije privremeno su bile usporene zbog ogromnog prometa koji su prouzročili botovi u želji da se dokopaju videosnimke predsjedničke debate iz 1980. godine. "Naša infrastruktura osmišljena je da izdrži porast prometa od ljudskih korisnika, ali količina prometa koju proizvode botovi dosad je nezabilježena i predstavlja sve veće rizike i troškove", napisano je iz Wikimedije u objavi na blogu.

Neki izdavači na te probleme odgovaraju tako što sklapaju sporazume s AI kompanijama kojima dobivaju naknade za pristup sadržaju, dok drugi jednostavno zaključavaju stranice. Taj trend mogao bi potkopati same temelje ideje o besplatnom i otvorenom internetu, upozorava Shayne Longpre, doktorand na MIT-u. "Prosječnom potrošaču bit će teže doći do određenih informacija bez plaćanja ili će se morati pretplatiti na određene AI botove kako bi do tih informacija i došao", kaže. Istovremeno, "manji internetski izdavači mogli bi završiti izostavljeni iz čitavog razgovora."

Ta tranzicija na internet chatbotova mogla bi predstavljati prijetnju i najvećim igračima. Najočitiji primjer za to mogao bi biti Google, čija se tražilica temelji na preusmjeravanju korisnika na druge izvore informacija. Kompanija je nedavno počela nuditi sažetke imena AI Overviews. Osim činjenice da povremeno nudi upitne savjete, Overviews bi ljudima mogao otežati i upravljanje stranicama na koje će druge osobe kliknuti. Bloomberg Businessweek već je izvijestio o tome kako je promet nekim izdavačima pao, a oni za to uglavnom krive upravo AI. Google pak odbacuje takvo objašnjenje i kaže kako postoje mnogi razlozi za rast ili pad prometa na određenim internetskim stranicama i kako AI Overviews "kreira nove prilike da poveže ljude i internetski sadržaj". Rast interneta koji pokreće AI dodatno naglašava kako su interesi tehnoloških divova često u suprotnosti s interesima korisnika njihovih usluga. U želji da baš oni zadominiraju budućnošću koju će predvoditi umjetna inteligencija, ubrzavaju tu tranziciju bez obzira na to je li svijet na nju spreman ili nije. Žele li korisnici Facebooka stvarno gledati AI račune razbacane među objavama prijatelja iz škole, kao što to zamišljaju direktori kompanija? Tko zna? No ako će takvo nešto ljude zadržati pred ekranima, Meta je spremna riskirati.

Nije teško zamisliti distopijski rezultat u kojemu se svi ti trendovi spoje u jednu, crnu točku, tvrdi Allen. U svijetu gdje stvarni ljudi više ne mogu dovoljno zaraditi mrežnim oglašavanjem kako bi osigurali preživljavanje svojih internetskih stranica, a njihove objave ne mogu se probiti kroz buku koju AI stvara na društvenim mrežama, mrtav internet odnosi pobjedu. Još je gore to što internet sugerira da se AI modeli mogu srušiti ako se obučavaju na sadržaju koji kreira AI. Bez mrežnog sadržaja nastalog ljudskom rukom, kaže Allen, "internet umire."

Menczer još nije do kraja povjerovao u taj najcrnji scenarij. Ako tehnološke kompanije dopuste da njihovi proizvodi postanu jeftini rasadnici botova, tvrdi, ljudi će se s vremenom jednostavno okrenuti nekamo drugamo. "Ako je omjer signala i buke toliko nizak da je bezvrijedan, ljudi će te platforme prestati koristiti", objašnjava. Tehnološke kompanije neće to dopustiti.

I to je možda istina. No opet, s druge strane, jedna od najpopularnijih objava na Facebooku prošle godine prikazivala je urednu sobu s ogromnim stropnim ventilatorom iznad modernog okvira kreveta. Slika je imala 179 tisuća reakcija. "Napokon sam pronašao savršen krevet za sebe", napisao je autor objave. "Sigurno se s ovim ne bih noću znojio!" Objava je sadržavala neke od karakteristika AI taloga – ventilator je izgledao malo iskrivljeno, a identične objave podijelili su i drugi korisnici, ali bilo je gotovo nemoguće točno potvrditi je li slika stvarna ili ne, a upravo je to poanta.

.png)